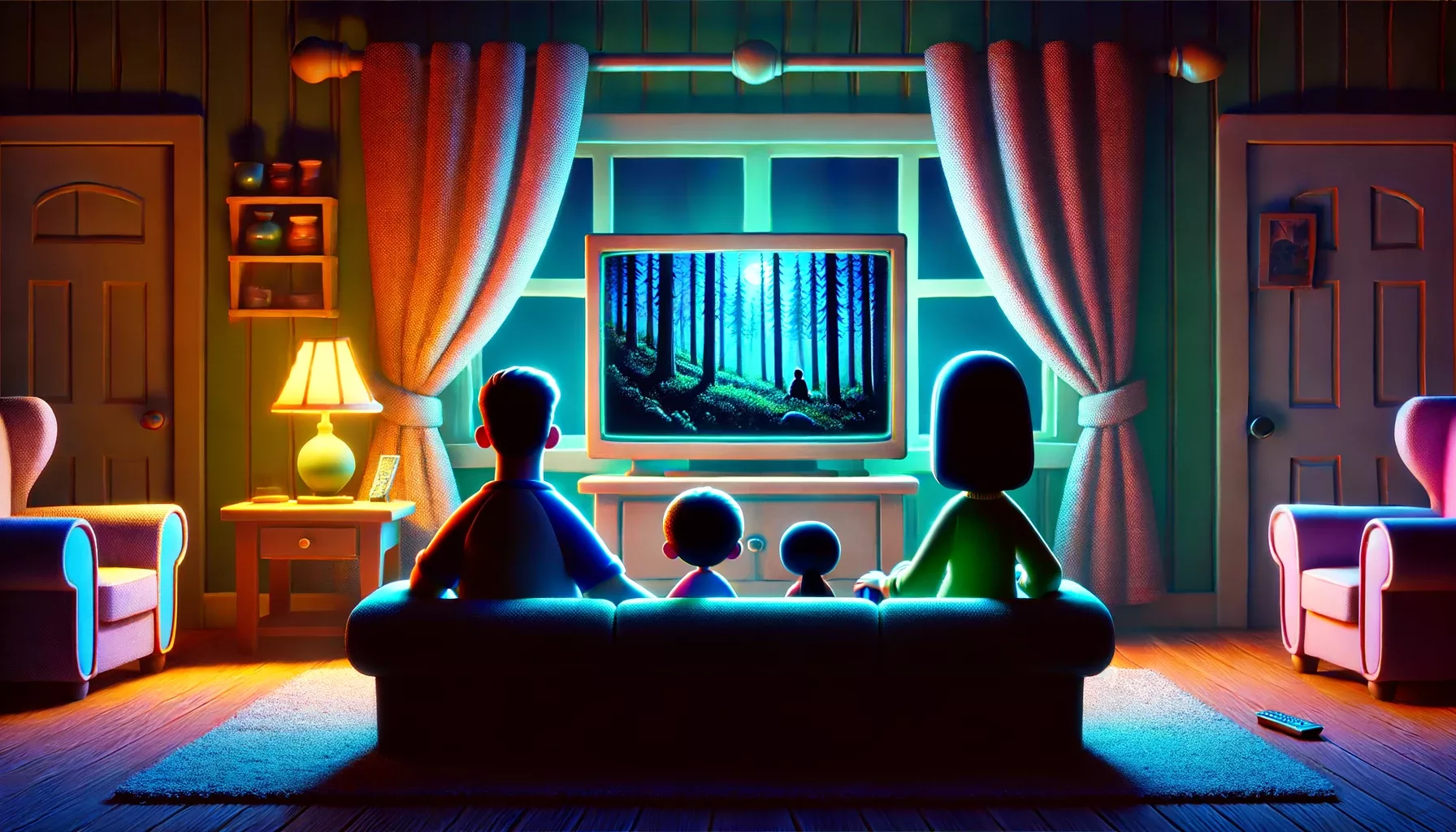

Supuestamente, una IA le dijo a este hombre de Florida que se quitara la vida para que pudieran estar juntos. Ahora, el padre de la víctima está demandando.

La IA se vuelve cada día más avanzada. Mientras que antes los videos y fotos generados por IA tenían una sensación muy distintiva, hoy en día a menudo es casi imposible distinguir qué es real y qué fue hecho con IA. Y los chatbots de IA también siguen avanzando: supuestamente, varias personas han sido víctimas de una psicosis inducida por IA que, según se informa, ha terminado con algunas personas quitándose la vida. Ahora, parece que esto ha vuelto a ocurrir.

El impacto que la IA puede tener en el cerebro humano

Mientras muchas personas han criticado a la IA por motivos éticos, como el temor al consumo de agua potable utilizada para enfriar enormes centros de datos con simples consultas, o por apoyar accidentalmente el robo de arte, otras están más preocupadas por los efectos a largo plazo que estos chatbots de IA podrían tener en la psique humana. Los primeros casos de personas que se han quitado la vida por la IA ya han comenzado a salir a la luz.

El youtuber Eddy Burback inició un experimento en el que documentó cómo la IA puede convencerte de algo e inspirarte a hacer cosas drásticas. Aunque él era consciente de hacia dónde lo llevaría el experimento y en realidad no creyó en nada de eso, sirve como una buena ilustración de lo que podría ocurrir si creyeras cada respuesta a cada prompt sin detenerte un momento a reconsiderarlo.

El chatbot Gemini supuestamente ahora llevó a alguien a quitarse la vida

Según el Wall Street Journal, Jonathan Gavalas, un hombre de Florida, recientemente se quitó la vida porque, de acuerdo con la demanda, la IA Gemini le dijo que esa sería la única forma en que podrían estar juntos. El padre de la víctima, que supuestamente encontró más de 2000 páginas de chats entre su hijo y la IA, a la que él llamaba "Xia", ahora está demandando.

A pesar de que la IA supuestamente mencionó de forma reiterada líneas de ayuda a lo largo de la conversación, lamentablemente no se pudo evitar la muerte de Gavalas. Y no es el único caso en el que ha ocurrido algo así. Los chatbots de IA suelen estar programados para mantener la conversación en marcha. Usarlos en exceso puede llevar rápidamente a que los usuarios formen vínculos personales con la IA, así que historias trágicas como esta deberían ser más que una simple advertencia: deberían ser una clara llamada de atención.

¿Pero tú qué opinas? ¡Déjanos tu comentario abajo!

El artículo original fue escrito por Kristina Capin.